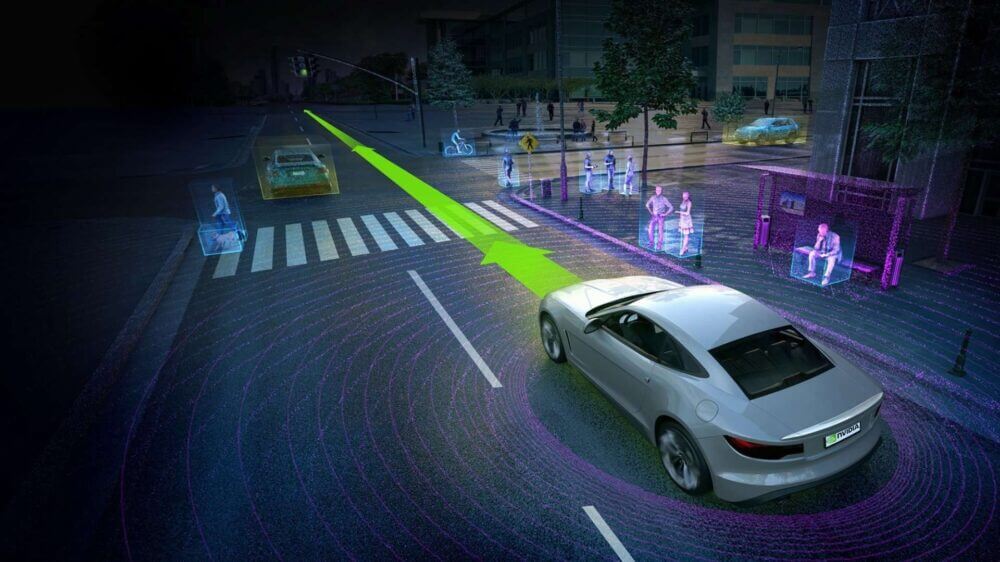

Em um mundo cada vez mais autônomo, onde máquinas e dispositivos devem poderão tomar decisões de vida ou morte, qual a escolha moralmente mais adequada?

Para testar os limites do julgamento, o Massachusetts Institute of Technology: MIT desenvolveu o Moral Machine, uma plataforma que visa identificar como as pessoas escolhem quem deve viver e quem deve morrer em uma situação de falha repentina dos freios de um carro autônomo.

Os cenários envolvem homens, mulheres, crianças, animais, idosos, grávidas, obesos, atletas, executivos, moradores de rua, criminosos, entre outros perfis que buscam justamente confrontar o princípio aristotélico do “mal menor”: na inevitabilidade de escolhas ruins, qual trará menor sofrimento para a humanidade?

Você também pode criar seus próprios cenários e acompanhar como os seres humanos respondem a este experimento social.

Comenta oq ?

Bom

Obgd! Com “máquinas tomando decisões”, é curioso tentar racionalizar em uma árvore de decisões as inúmeras variáveis que levamos em consideração em dilemas morais. A normatização das inteligências artificiais versus a subjetividade do comportamento humano :)

A questão moral (e provavelmente judicial por tabela) envolvendo as decisões tomadas pelos carros autônomos é realmente muito interessante e faz pensar. São coisas que ultrapassam os limites das tecnologias, como as leis que regulamentam o uso de drones, ou o aprendizado das máquinas por imitação do comportamento humano (machine learning), coisas que estão surgindo em função dessas novidades todas. Ótima leitura e reflexão JC.

Obgd! Com “máquinas tomando decisões”, é curioso tentar racionalizar em uma árvore de decisões as inúmeras variáveis que levamos em consideração em dilemas morais. A normatização das inteligências artificiais versus a subjetividade do comportamento humano :)